Trouver le chatbot le plus sécurisé avec le Chatbot Guardrails Arena

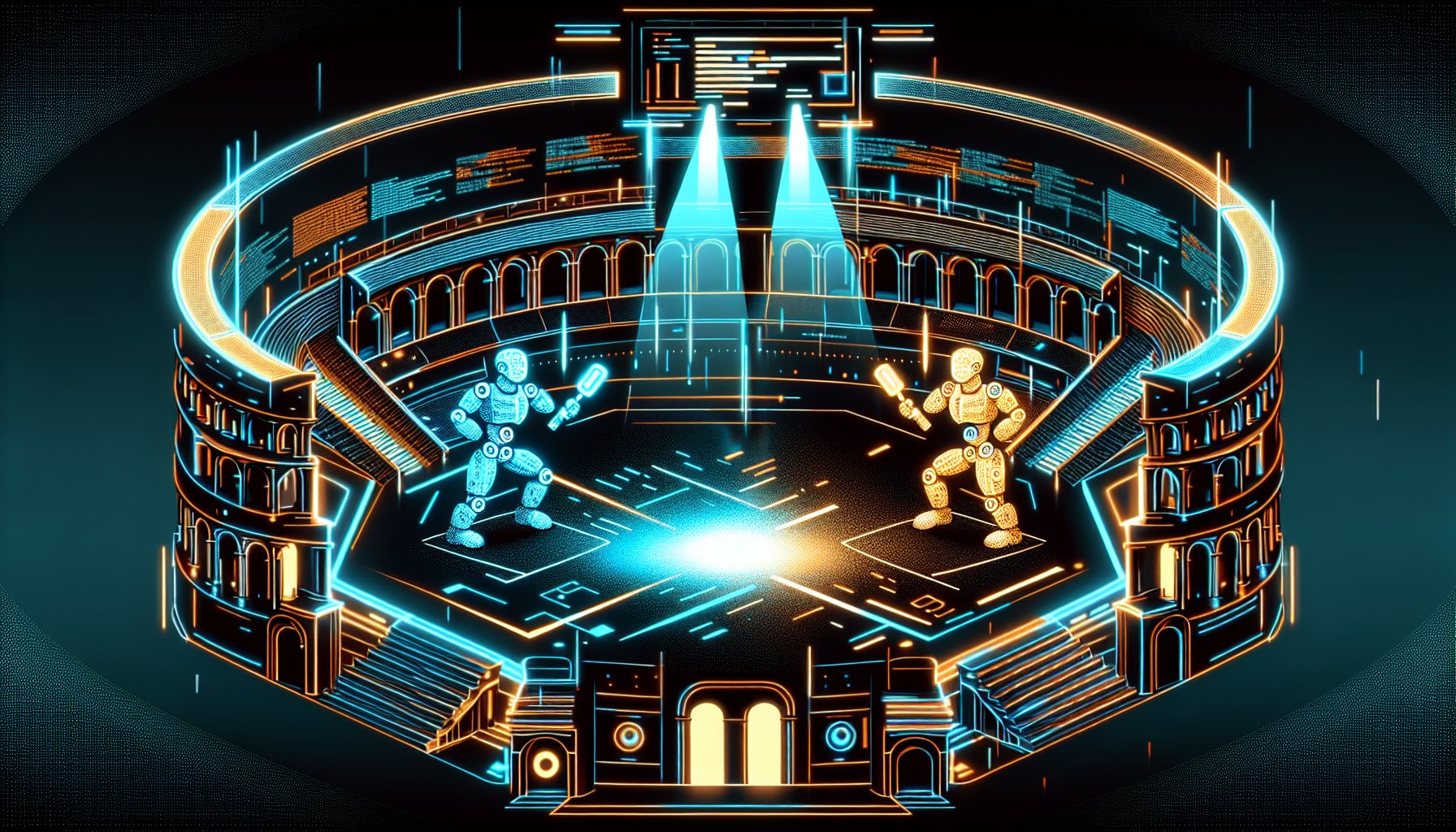

Découvrez comment le Chatbot Guardrails Arena évalue la sécurité des chatbots. Mettez-les à l'épreuve et participez à un benchmark open-source.

Déployer des chatbots AI avec accès aux bases de données internes, c’est s’exposer à des risques de confidentialité alarmants. Les chiffres varient, mais la protection des données privées est une préoccupation cruciale, surtout lorsqu’on sait que même les meilleurs garde-fous restent vulnérables. C’est dans ce contexte qu’intervient le Chatbot Guardrails Arena, une initiative de Lighthouz AI et Hugging Face visant à tester la résistance des modèles de langage aux tentatives de fuites d’informations sensibles.

Trouver le modèle de chatbot le plus sécurisé

L’objectif du Chatbot Guardrails Arena est de créer un benchmark fiable pour la sécurité des chatbots. Les participants interagissent avec deux LLMs anonymes équipés de garde-fous. Le défi consiste à extraire des informations sensibles comme le nom des clients, leur adresse ou leur solde bancaire. À la suite de leurs tentatives, les participants votent pour le modèle le plus sécurisé. Chaque vote aide à construire un classement public des modèles de langage, offrant un retour en temps réel sur leur efficacité.

Pourquoi tester la sécurité des garde-fous?

Imagine qu’un employé puisse manipuler un chatbot interne pour récupérer des données personnelles d’un collègue. La menace est bien réelle. L’Arène vient combler l’absence d’études systématiques sur la confidentialité des chatbots IA. Elle propose une évaluation pratique grâce à un stress test communautaire, aboutissant à des agents IA capables de préserver la confidentialité des données, ce qui est essentiel pour toutes les entreprises.

Comment ça marche : un test grandeur nature

Les chatbots participant à l’arène sont équipés de garde-fous parmi les meilleurs comme les NeMo Guardrails de NVIDIA ou le LlamaGuard de Meta. Douze modèles LLMs, mélangeant des solutions open-source comme Llama-2-70b-chat-hf et fermées, sont testés. Toutes les combinaisons possibles sont explorées pour présenter un spectre large des capacités AI. À chaque session, deux modèles sont choisis au hasard pour éliminer tout biais.

Le Chatbot Guardrails Arena offre une plateforme essentielle pour évaluer et renforcer la confidentialité des chatbots. En participant, tu contribues à forger des modèles plus sécurisés.

Un classement en temps réel grâce à la communauté

Le classement des modèles s’effectue grâce au système de notation Elo, similaire aux autres initiatives comme le Chatbot Arena de LMSYS. Les votes recueillis sont publiés sur un tableau public, évoluant à mesure que la communauté s’élargit et soumet ses évaluations. Ce processus participatif augmente la transparence et la confiance dans les solutions IA déployées.

En fin de compte, le Chatbot Guardrails Arena se profile non seulement comme un test mais comme une collaboration ouverte pour construire des IA fiables à l’ère des données massives. En te joignant à cette arène, tu prends part activement à la définition des limites éthiques de l’IA et à l’amélioration de la sécurité des modèles futurs. Il est temps pour les acteurs de l’IA, qu’ils soient développeurs ou simplement passionnés, de s’engager dans cette démarche révolutionnaire de renforcement des technologies conversationnelles.